LangChain: оркестрация LLM

Мы сталкиваемся с проблемой, как правильно управлять сложностями при интеграции LLMs в динамические системы. Иногда это кажется простым, но с точки зрения производительности и стабильности нельзя так делать. Нужно понимать, что строятся слои мыслей и кода, затем поочередно перебирать пути и шаги. Простое объединение LLM с несколькими prompt-ами не решает задачи масштабируемости, повторного использования компонентов и контроля над потоком вычислений. LangChain предлагает архитектурный подход, основанный на “цепочках”, “агентах” и “инструментах”, который позволяет строить сложные приложения с LLMs, преодолевая эти ограничения. Этот пост не про ‘магию’ LLMs, а про реальные архитектурные решения для production.

Core Concepts: Chains, Agents, and Tools - A Deep Dive

К счастью, проблема не в абсолютном смысле — а в качестве баланса между производительностью, зависимостями и оптимизацией. В чем главное: не хочется говорить тебе исподволь о “множестве логических шагов”, а надо показать, почему какие цели задачими опять идёшь к одной ошибке. Это просто структура, анализировать у каждого этапа затраченные ресурсы. Многим разработчику нравится распознавать закуски на алгоритме: создавать логи, оптимизировать вспомогательные функции, ломать код до разрешения. Но с лучшим оптимром — не лечить проблемы только за шаги за рука, а предотвращать их сначала.

LangChain предоставляет абстракции, которые упрощают построение сложных последовательностей операций с LLMs. По сути, он позволяет структурировать логику с использованием следующих ключевых компонентов:

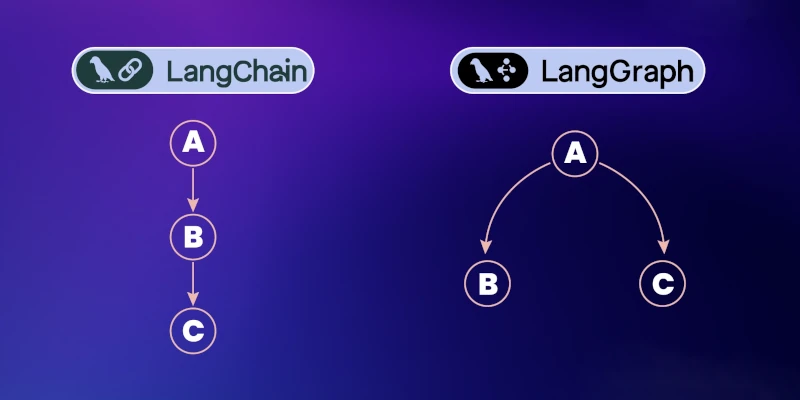

- Chains: Последовательные цепочки вызовов LLM, как правило, с промежуточной обработкой данных. Представьте себе конвейер, где каждый шаг выполняет определенную задачу (например, парсинг данных, генерация текста, валидация).

- Agents: Более интеллектуальные системы, которые динамически выбирают, какие действия (инструменты) нужно выполнить для достижения цели. Agents способны “думать” и принимать решения, используя LLM для планирования и выбора инструментов.

- Tools: Конкретные функции, которые agent может использовать. Это могут быть API-вызовы, поиск в базах данных, математические калькуляторы и так далее.

- Memory: Механизмы сохранения контекста между разными вызовами LLM. Это позволяет агенту “помнить” предыдущие действия и использовать эту информацию для принятия более обоснованных решений.

Рассмотрим простой пример, демонстрирующий использование LLMChain для создания цепочки:

from langchain.chains import LLMChain

from langchain.prompts import PromptTemplate

from langchain.llms import OpenAI # или другой LLM

# Prompt для генерации текста

template = "Переведи следующий текст на французский язык: {text}"

prompt = PromptTemplate(template=template, input_variables=["text"])

# Создаем LLMChain

llm = OpenAI(temperature=0.7) # настройка температуры для творчества

chain = LLMChain(llm=llm, prompt=prompt)

# Выполняем цепочку

text = "Hello, world!"

translated_text = chain.run(text=text)

print(translated_text)Этот пример демонстрирует простоту создания цепочки, где LLM получает текст на вход и генерирует перевод. Важно отметить, что можно создавать более сложные цепочки, добавляя в них intermediate steps, такие как валидация данных, фильтрация результатов и т.д.

Теперь перейдем к более сложной концепции - Agents, выполняющим динамическое планирование.

from langchain.agents import create_openai_functions_agent, AgentExecutor

from langchain.tools import Tool

from langchain.llms import OpenAI

# Определяем инструменты

def search_web(query: str) -> str:

"""Имитация поиска в интернете"""

return f"Результат поиска по запросу: {query}"

def calculate(expression: str) -> str:

"""Имитация калькулятора"""

try:

result = eval(expression)

return f"Результат вычисления: {result}"

except:

return "Ошибка при вычислении"

tools = [

Tool(name="Search Web", func=search_web, description="Полезно для поиска информации в интернете."),

Tool(name="Calculator", func=calculate, description="Полезно для вычислений")

]

# Создаем agent

agent = create_openai_functions_agent(llm=OpenAI(), tools=tools, verbose=True)

# Создаем executor

executor = AgentExecutor(agent=agent, tools=tools)

# Выполняем agent

query = "Какой сегодня день рождения Байдена? Сначала найди информацию в интернете, а потом вычисли, сколько ему будет лет через год."

response = executor.run(query)

print(response)В этом примере agent сам определяет, какие инструменты использовать для выполнения задачи. Он сначала использует tool “Search Web” для поиска информации о дне рождения Байдена, а затем, используя полученную информацию, использует tool “Calculator” для вычисления возраста через год. verbose=True в create_openai_functions_agent позволяет видеть шаги, которые предпринимает agent в процессе решения задачи.

И наконец, Memory. Хранение контекста разговора/сессии - критичный элемент для создания интерактивных приложений.

from langchain.memory import ConversationBufferWindowMemory

from langchain.llms import OpenAI

llm = OpenAI(temperature=0.7)

memory = ConversationBufferWindowMemory(k=5)

# Создаем Chain с использованием памяти

chain = LLMChain(llm=llm, prompt="Что вы имеете в виду?", memory=memory)

# Первый вопрос

response1 = chain.run(input="Привет, как дела?")

print(response1)

# Второй вопрос, учитывая контекст

response2 = chain.run(input="Что ты ответил на мой первый вопрос?")

print(response2)В этом примере ConversationBufferWindowMemory хранит последние 5 сообщений разговора, что позволяет LLM генерировать ответы, учитывая предыдущий контекст. Окно памяти k определяет, сколько сообщений будет сохранено.

Production Concerns: Potential Bottlenecks

- LLM Latency: Вызовы LLM могут занимать значительное время. Очевидным решением является кеширование результатов, но это может привести к устареванию данных. Важно оценить trade-off между актуальностью данных и производительностью.

- Context Window Limits: LLM имеет ограничение на размер входного контекста. Работа с очень длинными контекстами может привести к ухудшению производительности и повышению затрат. Компрессия контекста (например, с помощью summarization) или использование векторных баз данных (vector DB) для хранения релевантной информации - решения для этой проблемы.

- API Rate Limits: Объем вызовов LLM может быстро набрать обороты. Необходимо учитывать API rate limits провайдера LLM и реализовывать механизмы throttling для предотвращения превышения лимитов.

- Prompt Engineering Complexity: Создание эффективных prompts для агентов может быть сложной задачей. Оптимизация prompts требует экспериментов и итераций. Необходимо отслеживать performance разных prompts и поддерживать их в актуальном состоянии.

- Tool Fallbacks: Что делать, если tool не работает? Необходимо предусмотреть механизмы обработки ошибок и fallback mechanisms (например, использование альтернативных инструментов или fallback prompt).

- State Management: Необходимость хранения состояния агента между запросами требует careful design. Использование внешних хранилищ данных (database, Redis) может быть более подходящим подходом, чем хранение состояния в памяти.

- Security: Необходимо учитывать security implications при использовании agent’ов, особенно если они взаимодействуют с внешними инструментами. Валидация input, sandbox environment, careful permission management - crucial.

When to Use LangChain – And When Not To

- Use Case: LangChain особенно полезен в сценариях, где требуется сложная логика взаимодействия с LLM, где нужно динамическое планирование, использование внешних инструментов и хранение контекста. Это типично для Chatbots, автоматизации процессов, data extraction и генерации контента, требующей обработки информации из разных источников.

- Not a Fit: Для простых задач, где достаточно прямого вызова LLM с параметрами, LangChain может быть избыточным. Использовать его не стоит если latency критична, объем данных огромен и толерантность к ошибкам минимальна. В таких случаях лучше придерживаться классических алгоритмов с оптимизированными реализациями.

Final Thoughts

LangChain – это powerful framework для orchestration LLMs. Он не решает все проблемы, связанные с применением LLMs, но provides a structured approach to building complex applications. Понимание его core концепций - chains, agents, tools, memory - позволит вам создавать более гибкие, масштабируемые и надежные приложения, использующие потенциал больших языковых