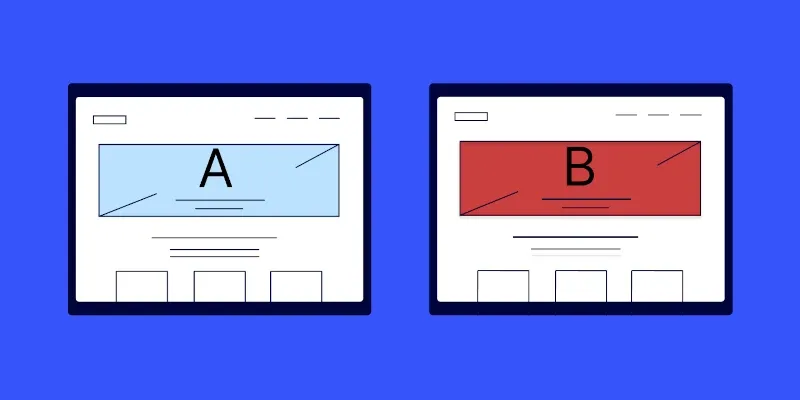

A/B тестирование моделей

A/B тестирование ML-моделей — это не просто статическое сравнение метрик на валидационной выборке. Это живой эксперимент в условиях реального трафика, где каждая ошибка в дизайне теста или интерпретации результатов может стоить миллионов долларов и сломать пользовательский опыт. Проблема в том, что большинство инженеров механически переносят подходы из веб-дизайна в мир ML, игнорируя специфику обучения моделей и непрерывный характер их эволюции.

Технические вызовы A/B тестирования ML-моделей

При внедрении A/B тестирования для ML-систем сталкиваешься с рядом нетривиальных проблем:

- Дрейф данных: В реальном мире распределение входных данных постоянно меняется, что делает результаты теста нестабильными.

- Непрерывная природа ML: В отличие от статических изменений UI, модели могут обучаться непрерывно, размывая границы между группами A и B.

- Множество метрик: Опасность множественных сравнений — при тесте 10 метрик вероятность ложного обнаружения эффекта возрастает до 40%.

- Сложные зависимости: Результаты модели часто влияют на поведение пользователей, создавая петли обратной связи.

Архитектура надежного A/B фреймворка

Эффективный A/B фреймворк для ML должен включать следующие компоненты:

- Система рандомизации с контролируемыми отклонениями — для минимизации систематических различий между группами.

- Механизм сбора метрик в реальном времени — с агрегацией на уровне пользователя и сессии.

- Статистические тесты с поправкой на множественность сравнений — Бонферрони, Холм или FDR-контроль.

- Мониторинг дрейфа данных — с использованием метрик вроде Population Stability Index (PSI).

- Система раннего остановки теста — для минимизации ущерба при обнаружении негативного эффекта.

Пример реализации A/B фреймворка на Python

import numpy as np

from scipy import stats

from collections import defaultdict

from dataclasses import dataclass

from typing import Dict, List, Tuple, Optional

@dataclass

class ABTestConfig:

"""Конфигурация A/B теста с контролем систематических ошибок"""

test_name: str

traffic_fraction: float # Доля трафика для тестовой группы

min_sample_size: int # Минимальный размер выборки для выводов

alpha: float # Уровень значимости

metric_names: List[str] # Список метрик для тестирования

class ABTester:

def __init__(self, config: ABTestConfig):

self.config = config

self.control_metrics = defaultdict(list)

self.test_metrics = defaultdict(list)

self.user_assignments = {} # Сохраняем назначения для контроля дубликатов

def assign_user(self, user_id: str) -> str:

"""Назначение пользователя в группу с контролем случайности"""

if user_id in self.user_assignments:

return self.user_assignments[user_id]

# Используем хеш для детерминированного рандома

random_value = hash(user_id) % 100

if random_value < self.config.traffic_fraction * 100:

group = 'test'

else:

group = 'control'

self.user_assignments[user_id] = group

return group

def record_metric(self, user_id: str, metric_name: str, value: float):

"""Регистрация значения метрики для пользователя"""

group = self.user_assignments.get(user_id)

if group is None:

return

if group == 'test':

self.test_metrics[metric_name].append(value)

else:

self.control_metrics[metric_name].append(value)

def _calculate_stats(self, control: List[float], test: List[float]) -> Tuple[float, float, float]:

"""Расчет статистики с учетом разного размера выборок"""

control_mean = np.mean(control)

test_mean = np.mean(test)

# Используем t-тест Уэлча для выборок разного размера

_, p_value = stats.ttest_ind(control, test, equal_var=False)

effect_size = (test_mean - control_mean) / np.sqrt((np.var(control) + np.var(test)) / 2)

return test_mean - control_mean, p_value, effect_size

def run_test(self) -> Dict[str, Dict]:

"""Запуск анализа результатов с поправкой на множественность"""

results = {}

# Поправка на множественность сравнений (метод Бонферрони)

adjusted_alpha = self.config.alpha / len(self.config.metric_names)

for metric in self.config.metric_names:

if len(self.control_metrics[metric]) < self.config.min_sample_size or \

len(self.test_metrics[metric]) < self.config.min_sample_size:

results[metric] = {

'status': 'pending',

'message': f'Недостаточно данных (control: {len(self.control_metrics[metric])}, test: {len(self.test_metrics[metric])})'

}

continue

delta, p_value, effect_size = self._calculate_stats(

self.control_metrics[metric],

self.test_metrics[metric]

)

significant = p_value < adjusted_alpha

results[metric] = {

'delta': delta,

'p_value': p_value,

'effect_size': effect_size,

'significant': significant,

'status': 'significant' if significant else 'not_significant'

}

return resultsУзкие места и компромиссы

-

Сложность сегментации: Простое разделение трафика 50/50 может создавать систематические различия из-за временных факторов. Решение: стратифицированная рандомизация по ключевым характеристикам.

-

Накопление ошибок: При последовательном тестировании нескольких версий вероятность ложных срабатываний увеличивается. Компромисс: либо использовать более строгие критерии значимости, либо применять Bayesian подходы.

-

Влияние на бизнес-метрики: Фокус на технических метриках (precision, recall) может не отражать реального влияния на бизнес. Решение: всегда включать в тест ключевые бизнес-показатели.

-

Стоимость экспериментов: A/B тестирование отложенного внедрения новых моделей. Компромисс: использование симуляций и офлайн-оценки для предварительного отбора кандидатов.

-

Проблема холодного старта: Новые модели часто хуже работают на новых пользователях. Решение: использовать прогрессивное внедрение или системы бустрапа для оценки поведения на новых сегментах.

Заключение

A/B тестирование для ML-моделей — это мощный инструмент, но требует продуманного подхода. Используйте его, когда:

- Тестируете значимые изменения в модели, влияющие на ключевые метрики

- Имеете достаточный трафик для статистически значимых результатов

- Можете позволить себе временно ухудшить качество для части пользователей

Избегайте A/B тестирования для:

- Незначительных изменений гиперпараметров

- Экспериментов на небольших сегментах аудитории

- Систем с критически важными бизнес-метриками, где нельзя позволить себе ухудшения

Вместо этого для таких сценариев рассмотрите Multi-armed bandit подходы или системы staged rollouts с постепенным увеличением доли трафика.