TensorRT: ускорение инференса

TensorRT — это компилятор нейросетевых моделей, который превращает ваш код в высокооптимизированные ядра для NVIDIA GPU. Не просто обертка, а настоящий компилятор, анализирующий граф вычислений и генерирующий специфичный для железа код. Когда миллисекунды определяют разницу между прибылью и убытком, TensorRT становится не опцией, а необходимостью — но за эту скорость приходится платить гибкостью и сложностью интеграции.

Технический вызов: Проблема оптимизации инференса

Представьте: ваша нейросетевая модель, идеально работающая в Jupyter Notebook, превращается в узкое место в production. Каждое предсказание занимает сотни миллисекунд, а пропускная способность измеряется десятками запросов в секунду. Проблема не в самой модели — в неоптимальном использовании вычислительных ресурсов GPU.

Ключевые ограничения стандартного подхода:

- Неоптимальное использование памяти GPU

- Отсутствие специализации под конкретную архитектуру

- Избыточные преобразования данных между слоями

- Неэффективное использование кэшей GPU

- Потенциал для конвейеризации вычислений

TensorRT решает эти проблемы, но не магически — через глубокую оптимизацию графа вычислений и генерацию специфичного для GPU кода.

Глубокий разбор механики работы TensorRT

TensorRT работает как настоящий компилятор, а не просто как фреймворк. Процесс состоит из нескольких этапов, каждый из которых критически важен для итоговой производительности.

1. Парсинг и построение графа

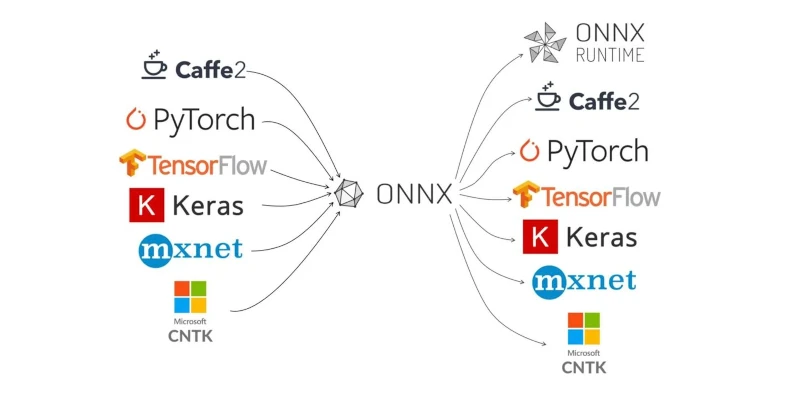

На этом этапе TensorRT анализирует входную модель (чаще всего в формате ONNX) и строит внутреннее представление графа вычислений. В отличие от фреймворков высокого уровня, TensorRT рассматривает модель не как набор абстрактных слоев, а как граф операций с конкретными типами данных.

# Пример парсинга ONNX модели с помощью TensorRT

import tensorrt as trt

def build_engine(onnx_file_path, engine_file_path, precision="fp32"):

logger = trt.Logger(trt.Logger.WARNING)

builder = trt.Builder(logger)

network = builder.create_network(1 << int(trt.NetworkDefinitionCreationFlag.EXPLICIT_BATCH))

parser = trt.OnnxParser(network, logger)

# Парсинг ONNX файла

if not parser.parse_from_file(onnx_file_path):

print("ERROR: Failed to parse the ONNX file.")

return None

# Настройка конфигурации

config = builder.create_builder_config()

config.set_memory_pool_limit(trt.MemoryPoolType.WORKSPACE, 1 << 30) # 1GB

# Установка точности вычислений

if precision == "fp16":

config.set_flag(trt.BuilderFlag.FP16)

elif precision == "int8":

config.set_flag(trt.BuilderFlag.INT8)

# Для INT8 требуется дополнительный калибровочный проход

# (рассматривается ниже)

# Создание и сериализация движка

engine = builder.build_engine(network, config)

if engine is None:

print("ERROR: Failed to build the engine.")

return None

# Сохранение скомпилированного движка

with open(engine_file_path, "wb") as f:

f.write(engine.serialize())

return engine2. Оптимизация графа

Это сердце TensorRT. Компилятор применяет множество оптимизаций:

- Объединение слоев (Layer Fusion): Слияние нескольких операций в одну ядерную функцию. Например, свертка + BatchNorm + ReLU могут быть объединены в один слой.

- Удаление мертвого кода: Исключение вычислений, результаты которых не используются.

- Оптимизация использования памяти: Минимизация количества аллокаций и копирований между GPU и памятью.

- Алгоритмическая оптимизация: Выбор наиболее эффективного алгоритма для конкретной операции на основе размера тензоров и возможностей GPU.

# Пример анализа и оптимизации графа

def analyze_and_optimize_model(onnx_path):

logger = trt.Logger(trt.Logger.INFO)

builder = trt.Builder(logger)

network = builder.create_network(1 << int(trt.NetworkDefinitionCreationFlag.EXPLICIT_BATCH))

parser = trt.OnnxParser(network, logger)

# Загрузка модели

if not parser.parse_from_file(onnx_path):

print("Error parsing ONNX")

return

# Создание конфигурации с расширенным логированием

config = builder.create_builder_config()

config.set_flag(trt.BuilderFlag.VERBOSE) # Подробный вывод для анализа

# Анализ слоев до оптимизации

print("Layers before optimization:")

for i in range(network.num_layers):

layer = network.get_layer(i)

print(f"{i}: {layer.name} ({layer.type})")

# Построение движка (триггер оптимизации)

engine = builder.build_engine(network, config)

if engine:

print("\nOptimization completed. Engine ready for deployment.")

else:

print("\nOptimization failed.")3. Квантизация

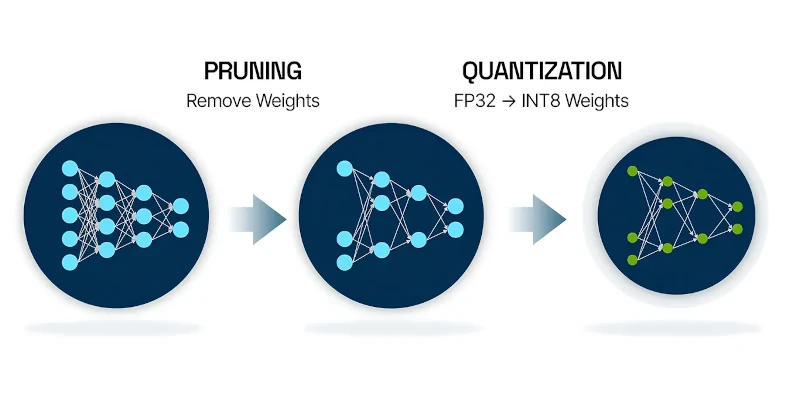

TensorRT поддерживает понижение точности для ускорения вычислений:

- FP16: Полуточная арифметика, дает значительный прирост на современных GPU

- INT8: 8-битная целочисленная арифметика, требует калибровки для сохранения точности

Для INT8 квантизация происходит в два этапа:

- Калибровка: Определение оптимальных квантизационных параметров на калибровочном датасете

- Переобучение: Коррекция весов для компенсации ошибок квантизации (опционально)

# Пример калибровки для INT8

class Int8EntropyCalibrator(trt.IInt8Calibrator):

def __init__(self, data_loader, cache_file=""):

trt.IInt8Calibrator.__init__(self)

self.data_loader = data_loader

self.dataloader_iter = iter(data_loader)

self.cache_file = cache_file

self.cache = bytearray()

def get_batch_size(self):

return 1 # Размер батча для калибровки

def get_batch(self, names):

try:

batch = next(self.dataloader_iter)

self.current_batch = batch

return [int(batch[n].cpu().numpy().tobytes()) for n in names]

except StopIteration:

return None

def read_calibration_cache(self):

if os.path.exists(self.cache_file):

with open(self.cache_file, "rb") as f:

return f.read()

return None

def write_calibration_cache(self, cache):

with open(self.cache_file, "wb") as f:

f.write(cache)

def get_algorithm(self):

return trt.CalibrationAlgoType.ENTROPY_CALIBRATION_2

def free(self):

pass

# Использование калибратора при построении движка

config = builder.create_builder_config()

config.set_flag(trt.BuilderFlag.INT8)

config.int8_calibrator = Int8EntropyCalibrator(calibration_dataloader)4. Генерация кода

На последнем этапе TensorRT генерирует CUDA-код, специфичный для архитектуры целевого GPU. Код включает:

- Оптимальное использование регистров и разделяемой памяти

- Конвейеризацию вычислений

- Специфические инструкции для архитектуры (Tensor Cores для FP16/INT8)

- Оптимальное использование кэшей L1/L2

Практические примеры интеграции

Инференс с использованием скомпилированного движка

import pycuda.autoinit

import pycuda.driver as cuda

import tensorrt as trt

import numpy as np

import time

class TRTModel:

def __init__(self, engine_path):

self.logger = trt.Logger(trt.Logger.INFO)

self.runtime = trt.Runtime(self.logger)

# Загрузка скомпилированного движка

with open(engine_path, "rb") as f:

engine_data = f.read()

self.engine = self.runtime.deserialize_cuda_engine(engine_data)

# Создание контекста

self.context = self.engine.create_execution_context()

# Выделение памяти на GPU

self.bindings = []

self.stream = cuda.Stream()

self.input_shape = self.engine.get_binding_shape(0)

for i in range(self.engine.num_bindings):

if self.engine.binding_is_input(i):

size = trt.volume(self.engine.get_binding_shape(i))

dtype = trt.nptype(self.engine.get_binding_dtype(i))

# Выделение памяти для входа

self.host_input = cuda.pagelocked_empty(size, dtype)

self.device_input = cuda.mem_alloc(self.host_input.nbytes)

self.bindings.append(int(self.device_input))

else:

size = trt.volume(self.engine.get_binding_shape(i))

dtype = trt.nptype(self.engine.get_binding_dtype(i))

# Выделение памяти для выхода

self.host_output = cuda.pagelocked_empty(size, dtype)

self.device_output = cuda.mem_alloc(self.host_output.nbytes)

self.bindings.append(int(self.device_output))

def infer(self, input_data):

# Копирование входных данных в GPU

np.copyto(self.host_input, input_data.ravel())

cuda.memcpy_htod_async(self.device_input, self.host_input, self.stream)

# Запуск инференса

self.context.execute_async_v2(bindings=self.bindings, stream_handle=self.stream.handle)

# Копирование результатов обратно в CPU

cuda.memcpy_dtoh_async(self.host_output, self.device_output, self.stream)

# Синхронизация

self.stream.synchronize()

return self.host_output

def __del__(self):

# Освобождение ресурсов

del self.device_input

del self.device_output

del self.host_input

del self.host_output

# Использование модели

model = TRTModel("model.trt")

input_data = np.random.randn(1, 3, 224, 224).astype(np.float32)

# Профилирование

start_time = time.time()

output = model.infer(input_data)

end_time = time.time()

print(f"Inference time: {(end_time - start_time)*1000:.2f} ms")

print(f"Output shape: {output.shape}")Динамическая форма входа

Многие современные приложения требуют обработки изображений или последовательностей переменного размера. TensorRT поддерживает динамические формы через механизм профилей.

# Пример создания движка с динамическими размерами

def build_engine_with_dynamic_shapes(onnx_file_path):

logger = trt.Logger(trt.Logger.WARNING)

builder = trt.Builder(logger)

network = builder.create_network(1 << int(trt.NetworkDefinitionCreationFlag.EXPLICIT_BATCH))

parser = trt.OnnxParser(network, logger)

if not parser.parse_from_file(onnx_file_path):

print("ERROR: Failed to parse the ONNX file.")

return None

config = builder.create_builder_config()

config.set_memory_pool_limit(trt.MemoryPoolType.WORKSPACE, 1 << 30)

# Настройка динамических профилей

profile = builder.create_optimization_profile()

# Определение минимальных, оптимальных и максимальных размеров

# для каждого измерения динамической оси

min_shape = (1, 3, 224, 224)

opt_shape = (8, 3, 224, 224)

max_shape = (16, 3, 224, 224)

# Установка профилей для входного тензора

profile.set_shape("input_tensor", min_shape, opt_shape, max_shape)

# Добавление профиля в конфигурацию

config.add_optimization_profile(profile)

engine = builder.build_engine(network, config)

if engine is None:

print("ERROR: Failed to build the engine.")

return None

return engineУзкие места в продакшене

Даже при идеальном использовании TensorRT существуют проблемы, которые могут снизить производительность в production:

-

Проблемы с памятью: -/workspace memory limit: TensorRT требует достаточного пространства для построения графа. Модели с большим количеством слоев могут превысить лимит. -Peak memory usage: Оптимизация может увеличить пиковое потребление памяти, что приведет к ошибкам при запуске на GPU с ограниченным VRAM. -Решение: Увеличение workspace memory limit через

config.set_memory_pool_limit(), использование стратифицированной квантизации для снижения потребления памяти. -

Поддержка кастомных операторов: -Многие современные архитектуры содержат кастомные слои, не поддерживаемые “из коробки”. -Решение: Разработка плагинов. Это требует глубоких знаний CUDA и архитектуры GPU.

# Пример простого плагина для кастомной операции class CustomPlugin(trt.IPluginV2, trt.IPluginV2Ext): def __init__(self, nc): self._nc = nc # Инициализация ресурсов CUDA def get_output_dtype(self, input_type): return input_type def forward(self, inputs, outputs, stream): # Реализация кастомной операции на CUDA # ... pass def create_plugin(self, name, field_collection): # Метод создания экземпляра плагина return CustomPlugin(self._nc) -

Проблемы с квантизацией: -INT8 квантизация может значительно снизить точность для некоторых моделей. -Калибровка требует репрезентативного датасета. -Решение: Использование продвинутых методов калибровки (Entropy Calibration), пост-калибровочное fine-tuning.

-

Сложность отладки: -Ошибка в TensorRT движке может быть трудно воспроизводимой. -Отсутствие стандартных инструментов отладки для CUDA-кода. -Решение: Использование verbose режима компиляции, логирование, сравнение результатов с reference реализацией.

-

Vendor lock-in: -Модель, скомпилированная для одной архитектуры NVIDIA GPU, может работать плохо на другой. -Требование драйверов CUDA и библиотек NVIDIA. -Решение: Контроль версий драйверов и библиотек, использование абстракций для возможного перехода на другие ускорители.

Заключение

TensorRT остается мощнейшим инструментом для оптимизации инференса нейросетей на NVIDIA GPU. Его компиляторный подход позволяет достичь пиковых характеристик производительности, которые невозможно получить с помощью универсальных фреймворков. Однако эта скорость достигается за счет сложности, времени на подготовку и потери гибкости.

Ключ к успешному использованию TensorRT — понимание его компромиссов и применимость к вашему конкретному случаю. Для статичных моделей с поддерживаемыми операторами, где производительность критична, TensorRT может дать прирост в 2-10 раз по сравнению с базовым CUDA-инференсом. Для динамичных или часто меняющихся моделей с кастомными операторами его применение может быть затруднено.