Трендовые github проекты в нашем телеграм канале. Подпишись 👉

Трендовые github проекты в нашем телеграм канале. Подпишись 👉 Celery: распределённые задачи

Celery — это не просто библиотека для фоновых задач в Python. Это полноценная распределенная система с тонкой настройкой производительности и надежности. Большинство разработчиков, использующих Celery, даже не догадываются о половине его возможностей, пока не столкнутся с потерей задач или утечками памяти в продакшене. Эта статья погрузит вас в глубину архитектуры Celery, покажет реальные примеры настройки. Мы разберем типичные ловушки, которые превращают распределенные задачи в головную боль.

Архитектура Celery: от брокера до воркера

Брокеры сообщений как основа

В основе Celery лежит брокер сообщений (RabbitMQ, Redis, Kafka и др.), который выступает в роли посредника между приложением и воркерами. Ключевое заблуждение — думать, что брокер просто передает сообщения. На самом деле он реализует сложную логику маршрутизации, подтверждения сообщений и устойчивости к сбоям.

RabbitMQ реализует AMQP протокол с понятиями exchange, queue и binding. Каждый обменник (exchange) определяет стратегию маршрутизации (direct, topic, fanout и headers), а очереди (queues) могут быть объявлены как durable (persistent) для выживания после перезагрузки. Redis, в свою очередь, использует более простую модель списков, но с возможностью использования pub/sub паттернов.

Trade-off: RabbitMQ обеспечивает более надежную гарантию доставки сообщений и продвинутые возможности маршрутизации, но Redis проще в масштабировании и имеет меньшие требования к ресурсам. Для задач, где потеря сообщения критична (финансовые транзакции), RabbitMQ предпочтительнее. Для задач, допускающих потерю (логирование, аналитика), Redis может быть достаточным.

Воркеры и их жизненный цикл

Воркер Celery — это не просто процесс, который выполняет задачи. Это сложная система с несколькими потоками/процессами, пулами выполнения и механизмами перезагрузки. Когда мы запускаем celery -A myapp worker, на самом деле создается следующая структура:

- Главный процесс (master) отвечает за сигналы и перезапуск дочерних процессов

- Рабочие процессы/потоки (worker) из пула выполняют задачи

- Прокси-объекты (prefetch) управляют загрузкой очереди

Критический момент: воркеры используют эвристику для определения завершенности задачи. Если задача завершилась с исключением, сообщение возвращается в очередь (с задержкой для предотвращения бесконечных циклов). Но если воркер упал в процессе выполнения, брокер не знает об этом и сообщение может быть потеряно, если не настроено подтверждение (ack).

Trade-off: Большое количество воркеров повышает пропускную способность, но увеличивает нагрузку на брокер и память. Оптимальное значение зависит от типа задач (CPU-bound vs I/O-bound) и ресурсов сервера. Для CPU-bound задач стоит использовать процессный пул (celery -A myapp worker --concurrency=4), а для I/O-bound - потоковый (celery -A myapp worker --concurrency=100 --threads=2).

Планирование задач: Beat vs. External Scheduler

Для периодических задач у Celery есть встроенный планировщик Beat. Но его использование — это компромисс между простотой и надежностью. Beat запускается как отдельный процесс и опрашивает базу данных каждые N секунд (по умолчанию 3) для поиска запланированных задач.

Проблема: если Beat упадет, периодические задачи перестанут выполняться до его перезапуска. Более надежный подход — использование внешних планировщиков (крон, Airflow, Prefect), которые вызывают Celery задачи через API.

Trade-off: Beat проще в настройке и не требует дополнительной инфраструктуры, но менее надежен. Для критичных систем лучше использовать внешний планировщик с механизмом повторов и мониторингом.

Настройка и оптимизация Celery

Конфигурация: что важно знать

Конфигурация Celery — это не просто параметры в settings.py. Это фундамент, от которого зависит производительность и надежность всей системы.

# Пример конфигурации Celery

app = Celery('myapp')

# Брокер и бэкенд для результатов

app.conf.broker_url = 'redis://localhost:6379/0'

app.conf.result_backend = 'redis://localhost:6379/1'

# Настройки надежности

app.conf.task_acks_late = True # Подтверждать задачу после выполнения

app.conf.task_reject_on_worker_lost = True # Возвращать в очередь при потере воркера

app.conf.task_default_queue = 'default'

app.conf.task_default_routing_key = 'default'

# Оптимизация производительности

app.conf.worker_prefetch_multiplier = 1 # Одновременно брать одну задачу

app.conf.task_acks_late = True # Подтверждать после выполнения

# Настройки retries

app.conf.task_annotations = {

'myapp.tasks.long_running_task': {

'max_retries': 3,

'retry_backoff': True,

'retry_backoff_max': 120,

}

}Ключевые моменты:

task_acks_late— задача подтверждается после выполнения, а не при получении. Это предотвращает потерю задач при падении воркера, но увеличивает нагрузку на брокер.worker_prefetch_multiplier— определяет, сколько задач воркер может забрать из очереди за раз. Значение 1 гарантирует, что при падении воркера будут потеряны только текущие задачи.

Мониторинг и отладка

Мониторинг Celery — это не просто графики. Это система раннего предупреждения о проблемах в продакшене. Основные метрики, на которые нужно обращать внимание:

- Длина очереди (queue length) — резкий рост может указывать на проблему с производительностью воркеров

- Время выполнения задач (task execution time) — увеличение может сигнализировать о утечках памяти

- Коэффициент ошибок (error rate) — рост указывает на проблемы в бизнес-логике

Инструменты:

- Flower — стандартный мониторинг для Celery, но он не масштабируется хорошо для больших систем

- Sentry — для отслеживания ошибок в задачах

- Prometheus + Grafana — для кастомных метрик

Практические примеры

Worker pools и контекстные задачи

Для разных типов задач нужны разные стратегии выполнения. Рассмотрим три основных паттерна:

# Пример 1: CPU-bound задачи - используем процессный пул

@app.task(bind=True)

def cpu_intensive_task(self, data):

# Вычислительно затратная операция

result = compute_heavy(data)

return result

# Пример 2: I/O-bound задачи - используем потоковый пул

@app.task(bind=True)

def io_intensive_task(self, data):

# Много сетевых запросов

result = []

for item in data:

result.append(fetch_data_from_api(item))

return result

# Пример 3: Короткие задачи - используя eventlet/gevent

from celery import Celery

app = Celery('myapp', broker='redis://localhost:6379/0',

backend='redis://localhost:6379/1')

@app.task(bind=True)

def short_task(self, data):

# Быстрая операция

process(data)Trade-off: Процессные пулы имеют большее накладные расходы, но изолируют друг от друга. Потоковые пулы эффективны для I/O операций, но не работают с CPU-bound задачами из-за GIL. Eventlet/gevent эффективны для большого количества коротких задач, но могут быть сложны в отладке.

Задачи с состоянием и результатами

Для задач, которые требуют отслеживания прогресса, Celery предоставляет механизм состояний. Но его реализация имеет нюансы:

from celery import Celery

from celery.result import AsyncResult

app = Celery('myapp', broker='redis://localhost:6379/0',

backend='redis://localhost:6379/1')

@app.task(bind=True)

def long_running_task(self, data):

# Обновляем состояние

self.update_state(state='PROGRESS', meta={'current': 0, 'total': 100})

for i, item in enumerate(data):

# Обработка элемента

process(item)

# Обновляем прогресс

current_progress = int((i / len(data)) * 100)

self.update_state(state='PROGRESS', meta={'current': current_progress, 'total': 100})

return {'status': 'SUCCESS', 'result': data}

# Получение результата и прогресса

result = long_running_task.delay(data)

while result.state != 'SUCCESS':

if result.state == 'PROGRESS':

print(f"Прогресс: {result.info['current']}%")

time.sleep(1)Trade-off: Механизм состояний удобен для пользовательского интерфейса, но создает дополнительную нагрузку на бэкенд. Для больших систем лучше использовать специализированные решения (Django Channels, Socket.io) для обновления прогресса в реальном времени.

Типичные проблемы и их решения

Проблема: утечки памяти в воркерах

Одна из самых частых проблем в продакшене — это утечка памяти в воркерах. Она проявляется как постепенное увеличение потребления памяти воркером до тех пор, пока ОС не начнет убивать процессы с помощью OOM Killer.

Причины:

- Глобальные переменные, накапливающие данные между задачами

- Неочищенные ресурсы (соединения с БД, файлы)

- Кэширование результатов без ограничения размера

Решения:

# Пример 1: Использование контекстных менеджеров для ресурсов

@app.task(bind=True)

def task_with_db_connection(self, data):

with get_db_connection() as conn:

# Работа с соединением

result = conn.query(data)

return result

# Пример 2: Ограничение размера кэша

from functools import lru_cache

@app.task(bind=True)

def task_with_cache(self, data):

@lru_cache(maxsize=100)

def expensive_computation(x):

return compute_heavy(x)

result = expensive_computation(data)

return result

# Пример 3: Регулярная перезагрузка воркеров

# В настройках Celery

app.worker_hijack_root_logger = False

app.worker_log_color = False

app.worker_lost_check = (

'celery.worker.strategy:default',

'celery.worker.autoreload:reload',

)Trade-off: Регулярная перезагрузка воркеров решает проблему утечек памяти, но прерывает выполнение текущих задач. Нужно найти баланс между стабильностью и производительностью.

Проблема: потеря задач при падении воркера

Если воркер падает во время выполнения задачи, результат может быть потерян, если не настроена правильная конфигурация.

Решения:

# В настройках Celery

app.conf.task_acks_late = True # Подтверждать задачу после выполнения

app.conf.worker_prefetch_multiplier = 1 # Брать по одной задаче

app.conf.task_reject_on_worker_lost = True # Возвращать в очередь при потере воркера

# Обработка исключений в задачах

@app.task(bind=True, autoretry_for=(Exception,), retry_kwargs={'max_retries': 3})

def reliable_task(self, data):

try:

# Работа с данными

result = process_data(data)

return result

except DatabaseError as exc:

# Повторить после задержки

raise self.retry(exc=exc, countdown=60)Trade-off: Увеличение количества retries повышает надежность, но может привести к дублированию операций. Для идемпотентных операций это не проблема, но для финансовых транзакций нужно реализовать дополнительную логику проверки.

Когда использовать Celery, а когда альтернативы

Сценарии использования Celery

Celery идеален для:

- Долгих операций, которые не должны блокировать основной поток (отправка email, обработка изображений)

- Регулярных задач (ежедневная генерация отчетов)

- Распределенных вычислений, где нужно разделить нагрузку между несколькими серверами

Не стоит использовать Celery для:

- Коротких операций (менее 100ms) — накладные перевесы перевешивают выгоду

- Задач с очень высокой скоростью (тысячи операций в секунду) — лучше использовать специализированные решения (Kafka, RabbitMQ без Celery)

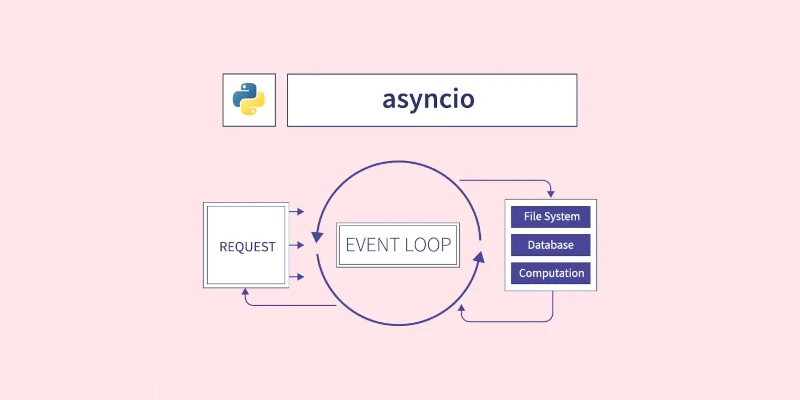

- Задач, требующих очень низкой задержки (<50ms) — здесь лучше подойдут асинхронные фреймворки (FastAPI, aiohttp)

Альтернативы Celery

- Django RQ — простая альтернатива на основе Redis и RQ, подходит для небольших проектов

- Dramatiq — более легковесный аналог с меньшими требованиями к ресурсам

- Prefect — современный фреймворк для workflow-автоматизации с лучшей поддержкой состояний

- Arq — асинхронный фреймворк на основе asyncio, подходит для высоконагруженных систем

Trade-off: Celery — это зрелое решение с большой экосистемой, но оно может быть избыточным для простых случаев. Новые фреймворки часто легче и эффективнее, но имеют меньше интеграций и менее зрелы.

Заключение

Celery остается мощным инструментом для обработки фоновых задач в Python, но его использование требует понимания внутренней работы и компромиссов. Для критичных систем нужно дополнительно реализовать мониторинг, обработку ошибок и механизмы повторов. В то же время, для простых сценариев стоит рассмотреть более легковесные альтернативы. Главное — понять, что ни одна система не идеальна, и каждый выбор это всегда компромисс между надежностью, сложностью и производительностью.